大数据时代 Hadoop如何破解数据处理的三大瓶颈

随着信息技术的飞速发展,人类社会已全面步入大数据时代。海量、多样、高速的数据洪流为各行各业带来了前所未有的机遇,同时也对传统的数据处理模式提出了严峻挑战。面对数据存储、计算与管理的三大核心瓶颈,以Hadoop为代表的分布式计算框架应运而生,并已成为支撑现代数据处理服务的基石。

瓶颈一:海量数据存储的困境

传统的数据存储方案,如集中式数据库或存储区域网络(SAN),在面对PB乃至EB级别的非结构化或半结构化数据时,往往显得力不从心。其扩展性差、成本高昂,难以满足指数级增长的数据存储需求。

Hadoop的解决方案:HDFS(Hadoop分布式文件系统)

Hadoop通过其核心组件HDFS,从根本上改变了数据存储范式。HDFS将超大文件自动分割成多个数据块,并分布式地存储在一个由廉价商用硬件构成的集群中。它通过多副本机制确保数据的可靠性与高容错性,即使部分节点失效,数据也不会丢失。这种设计实现了近乎线性的存储扩展能力,允许企业以较低的成本构建起可容纳海量数据的“数据湖”。

瓶颈二:高并发与复杂计算的性能瓶颈

传统的串行或小型并行计算框架,在处理大规模数据集上的复杂分析任务(如机器学习、日志分析、数据挖掘)时,计算速度成为主要瓶颈。任务运行时间可能长达数天甚至数周,严重阻碍了实时或近实时的商业决策。

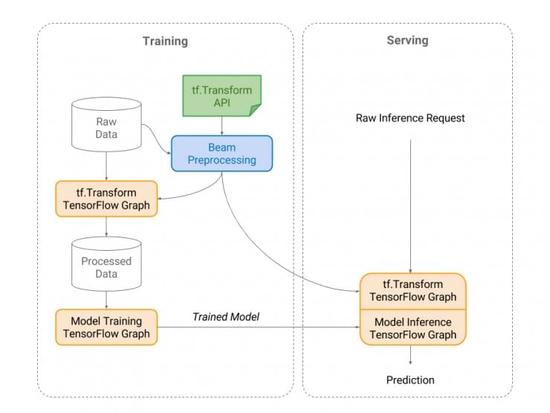

Hadoop的解决方案:MapReduce与YARN计算模型

Hadoop引入了MapReduce编程模型,将复杂的计算任务分解为两个阶段:“Map”(映射)和“Reduce”(归约)。这种模型允许计算任务被高度并行化,分发到存储有数据的各个节点上执行,遵循“移动计算而非移动数据”的原则,极大减少了数据传输开销,显著提升了处理速度。

其后,Hadoop 2.0引入的资源管理与调度框架YARN(Yet Another Resource Negotiator),将资源管理与作业调度/监控功能分离,使得Hadoop集群能够支持多种计算框架(如Spark、Tez、Flink),不仅限于MapReduce。这极大地提高了集群的资源利用率和计算灵活性,能够高效处理批处理、交互式查询、流处理等多种计算范式。

瓶颈三:数据管理与协同处理的复杂度

大数据环境下的数据往往格式多样、来源异构,对其进行有效的管理、清洗、整合并支持多用户、多团队的协同分析与处理,是一个极其复杂的系统工程。缺乏统一的管理平台会导致数据孤岛、处理流程混乱、资源争用和运维困难。

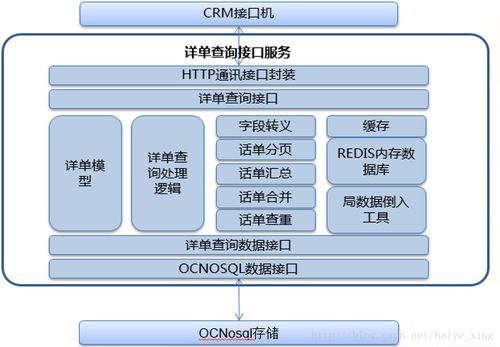

Hadoop的解决方案:丰富的生态系统与数据处理服务

Hadoop远不止是一个存储与计算引擎,它已成长为一个庞大的生态系统。围绕其核心,衍生出了一系列高效的数据管理、处理与查询工具,共同构成了强大的数据处理服务栈:

- 数据集成与处理:Apache Hive 提供了类SQL的查询接口,使得传统数据分析师也能轻松处理大数据;Apache Pig 提供了高级数据流语言,适用于复杂的数据转换流水线;Apache Sqoop 和 Flume 则分别负责在Hadoop与关系数据库、以及日志流数据之间的高效传输。

- 协调与管理:Apache Zookeeper 为分布式应用提供可靠的协同服务,如配置维护、命名服务、分布式同步等,是保障集群稳定运行的关键。

- 高级计算与实时处理:Apache Spark 凭借其内存计算和DAG执行引擎,在迭代计算和流处理上性能远超传统MapReduce;Apache HBase 则提供了Hadoop之上的分布式、可伸缩的NoSQL数据库,支持实时读写随机访问。

这些工具与HDFS、YARN无缝集成,共同构建了一个统一、可扩展、易于管理的数据处理服务平台。企业可以在此平台上,从数据采集、存储、清洗、计算到分析与可视化,完成端到端的数据流水线作业,有效管理数据资产,赋能多团队协同工作。

###

在大数据时代,数据处理的核心矛盾在于数据规模的膨胀与处理能力局限之间的冲突。Hadoop通过其分布式存储(HDFS)、分布式计算(MapReduce/YARN)以及繁荣的生态系统,系统地解决了海量数据存储、高并发复杂计算和协同管理这三大瓶颈。它奠定了现代大规模数据处理服务的基础架构,使得从海量数据中快速提取价值成为可能,持续驱动着商业智能、科学研究和互联网服务的创新与发展。尽管新一代计算框架(如Spark、Flink)在某些场景下表现更优,但Hadoop构建的底层思想与生态体系,依然是大数据领域不可或缺的基石。

如若转载,请注明出处:http://www.wsxerb.com/product/16.html

更新时间:2026-05-28 07:27:53